Round-Up: Die Highlights der Google I/O 2017

Es ist doch jedes Jahr dasselbe: Google-Fans sitzen ganz hibbelig vor ihren Bildschirmen und warten nur noch darauf, dass der Livestream zur jährlichen Keynote der Google I/O startet. Und dieses Jahr lieferte Google einiges in den zwei Stunden ab. Und was uns Google da genau präsentierte, fassen wir in diesem Artikel zusammen: vom Google Assistant über Google Lens, dazwischen noch ein bisschen YouTube bis hin zu Android O. Viel Spaß!

Erstaunliche Zahlen

Zu Beginn der Keynote präsentierte Google CEO Sundra Pichai einige spektakuläre Zahlen. Haltet Euch besser fest, denn diese Zahlen haben es durchaus in sich. So nutzen mittlerweile über eine Milliarden (!) aktive Nutzer einige Google-Dienste, darunter Maps, Play, GMail, YouTube, etc…, täglich! Darüberhinaus zählt man dieser Tage 2 Milliarden aktive Android-Geräte (es zählen nur Smartphones & Tablets in diese gigantische Zahl). Auch wurden im Play Store im vergangenen Jahr rund 82 Milliarden Apps heruntergeladen und auf YouTube werden täglich weltweit 1 Milliarden Stunden Videomaterial angesehen. Hut ab, Google!

Mobile first to AI first

Google Lens

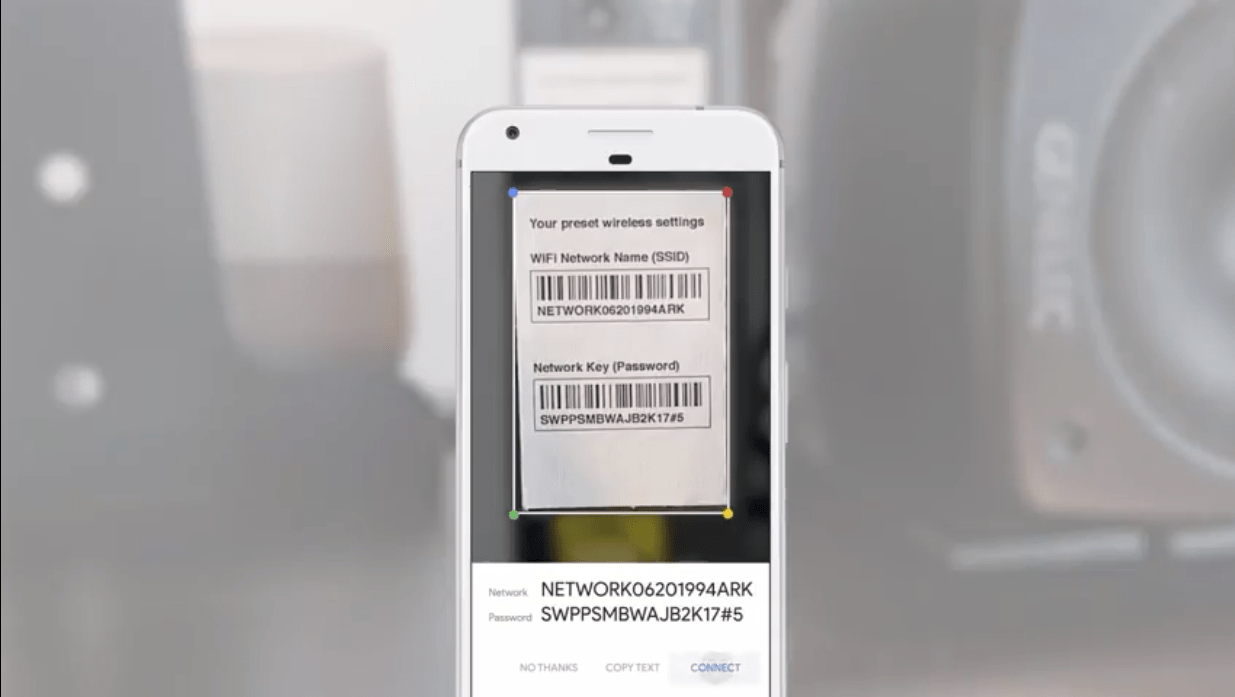

Stell Dir vor, Du bist bei einem Kumpel und möchtest sein WLAN mitnutzen. Dein Kumpel legt Dir einen Zettel mit der SSID sowie dem Passwort hin. Da wir bekanntlich zu faul zum Tippen sind, können wir dank Google Lens einfach nur unser Smartphone draufhalten und schon werden wir mit dem WLAN verbunden, ohne auch nur einen Buchstaben tippen zu müssen. Oder Du bist im Wald Pilze sammeln und möchtest wissen, was das für ein Pilz ist und ob dieser giftig ist. Auch für dieses Szenario ist Lens ausgelegt.

Doch diese Technologie existiert schon seit geraumer Zeit in einer – sagen wir fast vergessenen – App namens Google Googles, welche jedoch seit längerem nicht mehr weiterentwickelt wird. Der Vorteil an Lens ist, dass dies in Verbindung mit dem Google Assistant die Informationen (bspw. die WLAN Login-Daten) für den späteren Abruf speichern soll. Ob Google Lens zusätzlich als eigene App verfügbar ist oder nur in den Google Assistant integriert wird, bleibt offen.

Google Home & Google Assistant

Die gestrige Keynote stand ganz im Namen von künstlicher Intelligenz (AI). Und so verwunderte es nicht, dass Google seinen Amazon Echo Konkurrenten Google Home noch im Sommer auch nach Deutschland, Frankreich, Japan, Australien und Kanada bringen möchte. Dazu wird zunächst die deutsche Version des Google Assistent in den kommenden Wochen und Monaten deutlich verbessert.

Aber Google Home und der Assistant werden auch in ihrem Funktionsumfang deutlich erweitert: Ähnlich wie Amazon nutzt bald auch Google ein Display, um kontextuelle Informationen anzeigen zu können. Anders als Amazon beim Echo Show setzt Google dabei auf die bereits vorhandenen Infrastruktur des Nutzers, welche selbstverständlich aus weiteren Google-Produkten besteht. Google Home wird schon bald Antworten und andere Inhalte direkt über die Cast-Technologie oder einen Chromecast auf den Fernseher des Nutzers streamen und diesen so als Display zweckentfremden.

Der Google Assistent bekommt ebenfalls einige neue Funktionen wie bspw. das Erstellen von Erinnerungen und Kalendereinträgen. Per Software-Update kann Google Home künftig auch als Bluetooth-Lautsprecher verwendet werden. Interessant, dass diese beiden Funktionen bisher nicht zur Verfügung standen. Ein großer Nachteil vieler virtueller Assistenten ist, dass sie lediglich auf Spracheingaben reagieren können. Das will Google künftig ändern und auch textbasierte Eingaben ermöglichen.

Der Googles Assistent wird dem Nutzer künftig auch auf dem iPhone zur Seite stehen. Doch nicht nur das: Mit einem SDK will der Suchmaschinengigant Hersteller aller möglichen Produktkategorien ermöglichen, den Google Assistent in ihre Produkte einbauen zu können. Entwickler sollen zudem die Möglichkeit erhalten, Actions für Googles smarten Assistenten zu programmieren – Amazon nennt diese Integrationen von Drittanbietern Skills. Außerdem sollen auf allen Geräten möglichst alle Funktionen des Assistenten zur Verfügung stehen.

Kommen wir nochmal kurz auf Google Lens im Google Assistant zurück. Als fauler Mensch möchten wir uns gerne alles erleichtern. So z. B., wenn man irgendwo ein Plakat von einem Event sieht und dort unbedingt hin möchte, man aber zu Faul ist, sich einen Eintrag in den Kalender zu machen. Nun reicht ein “draufzeigen” mit der Kamera und durch Google Lens wird erkannt, um welches Event es sich handelt und in welchem Zeitraum es stattfindet. Der Google Assistant bietet an dieser Stelle nun an, einen Termin im Kalender anzulegen oder Tickets dafür zu reservieren.

Smart Reply in GMail

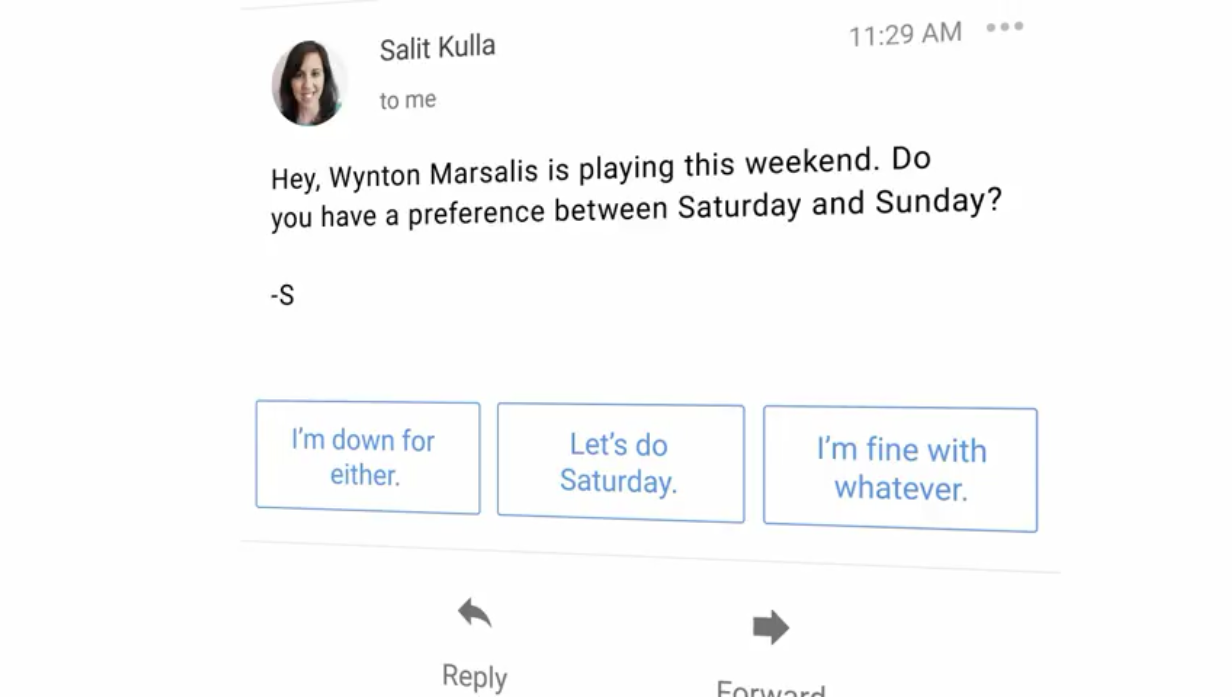

Seit dem Launch von Googles Messenger Allo im vergangen Jahr gibt es die Smart Reply Funktion. Diese versucht, dem Nutzer passende Antworten auf den Chatverlauf anbieten zu können. Nun kommt diese Funktion auch in GMail.

Gegenstände von Fotos entfernen

Google ist in Sachen Bilderkennung an vorderster Front unterwegs, was durch Google Fotos schon lange bekannt ist und durch Google Lens erneut bestätigt wurde. Doch jetzt legt Google noch eins drauf: Du bist bspw. auf einem Baseballspiel von Deinem Sohn, hast jedoch nur einen Platz hinter dem Zaun bekommen. Fotos zu machen ist jetzt natürlich blöd. Doch mit einer neuen Technologie von Google kann nun ein solcher störender Zaun entfernt werden. Die durch das Entfernen des Zauns gelöschten Pixel werden durch Algorithmen und den umgebenden Pixeln neu berechnet, wodurch sich mit bloßem Auge nichts von einer solchen Änderung erkennen lässt. Wow!

Wo wir diese Technologie finden werden, ließ Google gestern nicht verlauten, doch höchst wahrscheinlich darf sich die Bildbearbeitung von Google Fotos darüber erfreuen.

Google Fotos

Vor rund zwei Jahren zeigte Google auf der I/O den Dienst Google Fotos. Seither hat sich dieser prächtig entwickelt. So nennt Google während der Keynote einige beachtliche Zahlen: Über 500 Millionen Nutzer laden täglich 1,2 Milliarden Fotos/Videos hoch. Für diese 500 Millionen User gibt es künftig neue Funktionen.

So soll unter anderem das Teilen von Bildern vereinfacht werden. Der Mensch sei laut Google faul und vergesslich, weshalb die Funktion „Suggested Sharing“ die Lösung sei: Google erinnert die Nutzer bald daran, die besten Fotos mit den Personen auf dem Foto teilen zu können. Hierfür nutzt Google seine Google Lens getauften Algorithmen.

Info: Mit dem Klick auf das Video werden Daten an YouTube übertragen.

Doch damit nicht genug. „Shared Libraries“ soll das Teilen und Synchronisieren von Fotos noch einfacher machen: Um mehrere Fotos mit bestimmten Personen zu teilen, war bisher das Anlegen von Alben notwendig. Diese Alben mussten dann wiederum geteilt werden. Um dies zu vereinfachen und automatisch die richtige Fotos mit den richtigen Personen zu teilen, werden schon bald „Shared Libraries“ eingeführt.

Zusätzlich wird es (vorerst) nur in den USA eine dritte neue Funktion geben: Google Photos erstellt automatisch Fotobücher, die dann vom Nutzer angepasst und für rund $ 10 bestellt werden können. Googles Algorithmen wählen Dir automatisch die besten und schönsten Fotos aus und platzieren diese dann im Fotobuch.

YouTube: SuperChat API

Lang ist’s her mit dem SuperChat von YouTube. Man bezahlt etwas Geld und wird dadurch in den Kommentaren bei einem Livestream hervorgehoben. Und das war’s. Doch nun dürfen sich auch Entwickler ran wagen und ihre eigenen Dinge für SuperChat entwickeln, wie bspw. das Fernsteuern von Lichtern etc. Was letztlich alles möglich ist, ist zur Zeit noch nicht klar, doch das wird sich demnächst hoffentlich ändern.

Android O(ho)

Ja, auch Android wurde nicht vergessen, jedoch wurde darüber nicht großartig viel erzählt. Dass es eine Android O Developer Preview gibt, war sowieso schon im Vorfeld klar, doch einige kleine Neuerungen gibt es. Wir fügen an dieser Stelle ebenfalls gleich noch alle bekannten Dinge ein, die nicht erwähnt wurden, aber bereits in der Developer Preview verfügbar sind.

Picture in Picture

Wie bereits unter iOS möglich, lassen sich nun Videos auch in einem kleinen Fenster im Bildschirm anschauen, während man sein Smartphone ganz normal weiter nutzen kann.

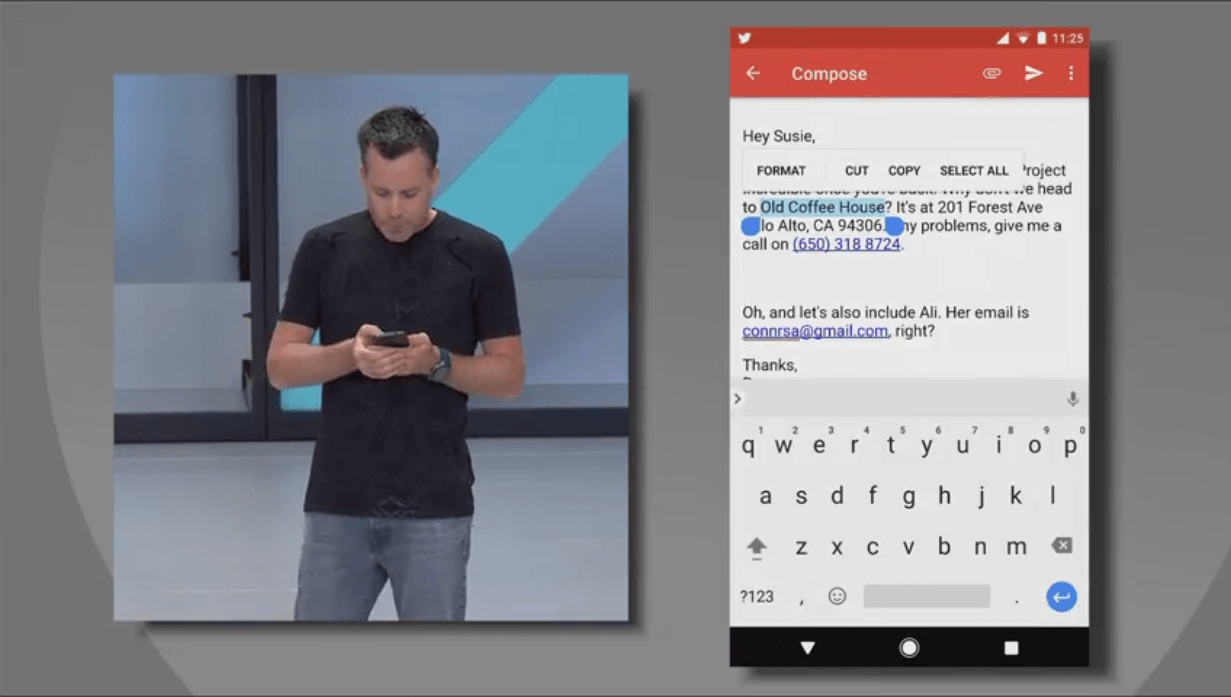

Smarte Textauswahl

Wer hasst es nicht beim Kopieren von Adressen oder Telefonnummern: Sobald man auf ein Wort geklickt hat, muss man jedes Mal die Textauswahl auf die gesamte Adresse ausweiten. Nun erkennt Euer Gerät, dass es sich um eine Adresse handelt und wählt somit den gesamten Text aus, der zur Adresse gehört und gibt im Copy & Paste-Menü einen App-Vorschlag. Bei Adressen bspw. Google Maps, bei Telefonnummern die Telefon-App etc.

Notification Dot

Wenn Du eine Benachrichtigung bspw. über WhatsApp bekommst, wird auf dem Icon nun ein kleiner Punkt angezeigt, wodurch ein neuer Nachrichteneingang signalisiert werden soll. Damit man nun die Benachrichtigungsleiste nicht öffnen muss, kann man nun auch das App-Icon gedrückt halten und im nachfolgenden Menü die Benachrichtigung aufrufen.

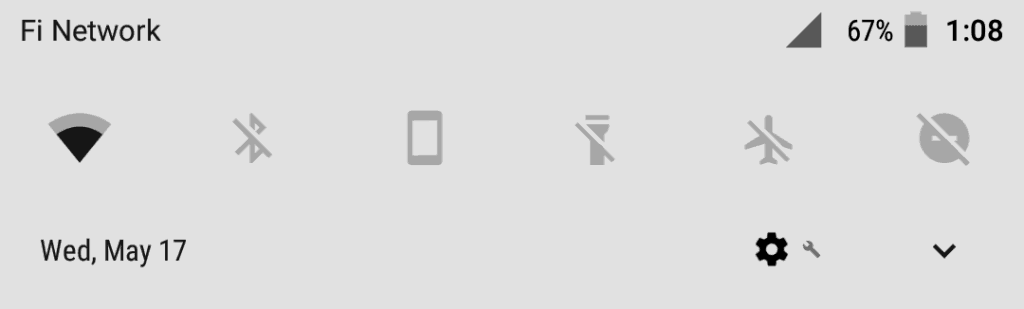

Neues Design der Quicksettings

Die Quicksettings sind nun nicht mehr farbig, sondern setzen nur noch auf Schwarz und Grau. Auch die Anordnung der Punkte ändert sich.

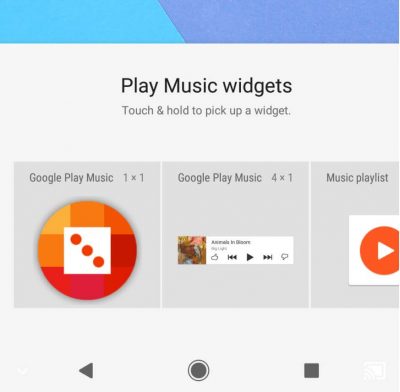

Widgets im App Shortcut

Du willst Deinem Homescreen ein Widget einer bestimmten App hinzufügen, hast aber keine Lust, Dich durch die ewig lange Liste aller Widgets zu wühlen? Gut, denn mit Android O reicht ein langer Klick auf das App-Icon und schon werden Dir alle verfügbaren Widgets der App angezeigt.

App-Icon Form ändern

Du magst es lieber rund, mit abgerundeten Ecken oder doch ganz rechteckig? Dank der Adaptiven Icons ist dies unter Android O von nun an kein Problem mehr!

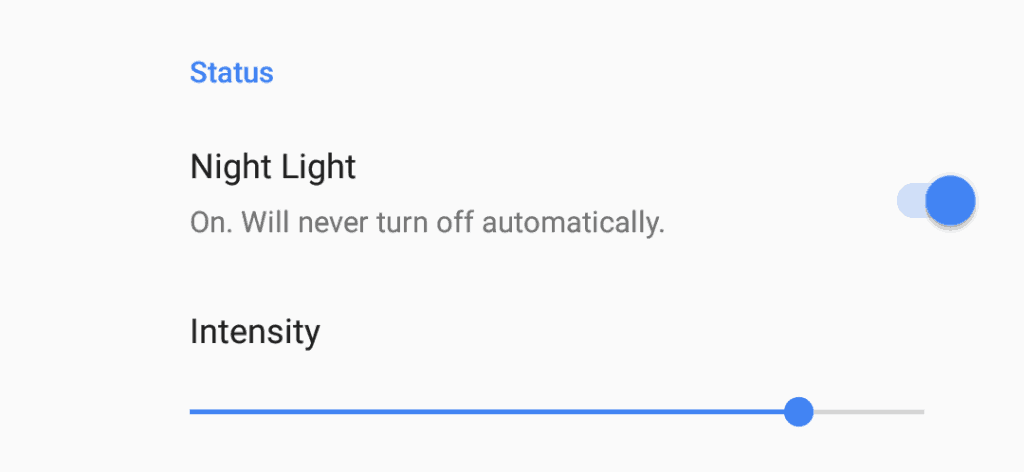

Anpassbares Night-Light

“An” oder “Aus”. Mehr ist aktuell in Android Nougat nicht verfügbar in Sachen Nachtmodus. Doch mit Android O ändert sich alles, denn nun bestimmst Du mit einem Schieberegler, wie stark das Blaulicht verbannt wird.

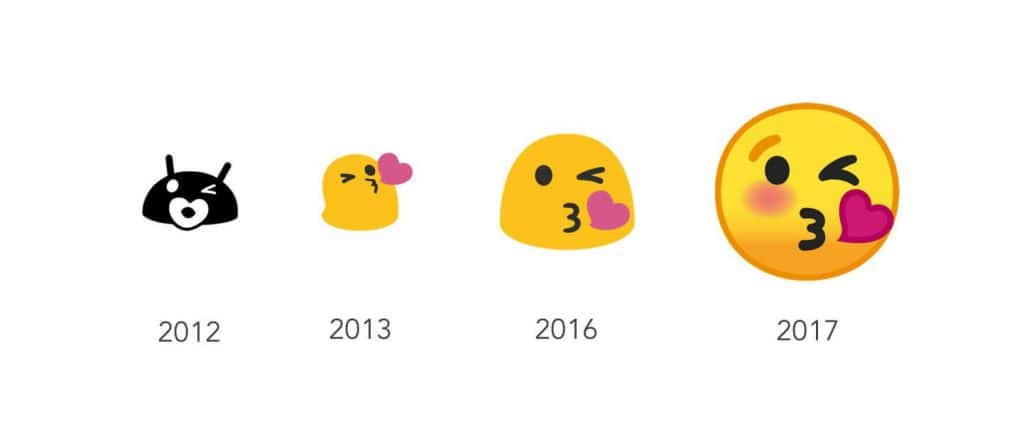

Neue Emojis

Wer hat sie nicht geliebt, die guten alten Blobs? Mit Android O werden diese nun durch neue “richtige” Emojis ersetzt. Für mich als Liebhaber der Blobs ein wahrer Schock.

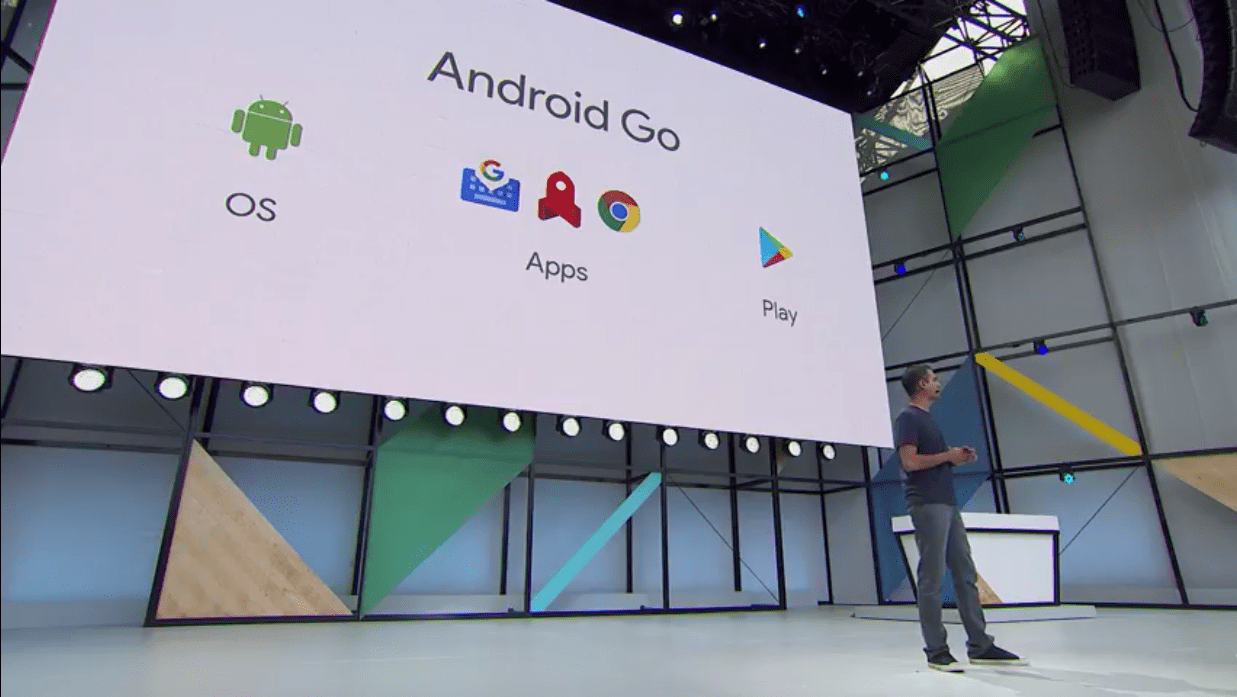

Android Go!

Nein, nicht Angry Birds Go, auch nicht Pokémon Go, sondern Android Go. Android Go wird das seit zwei Jahren existierende Programm Android One ersetzten und wie sein Vorgänger auf hardware-schwächeren Smartphones, gerade für Entwicklungsländer, eingesetzt werden. Android Go soll parallel zu Android O laufen, jedoch nicht so hohe Anforderungen an die Hardware stellen. Für die passenden Apps soll eine eigene Kategorie im Play Store sorgen, wo nur Go-fähige Apps zu finden sind. Android Go soll in rund 191 Sprachen zur Verfügung stehen und stets aktuell gehalten werden.

VR-Brille ohne Smartphone

Letztes Jahr zeigte uns Google mit Daydream eine hochwertige Version eines VR-Headsets mit ausgewählten, sogenannten “Daydream-ready”-Smartphones. Nun gab Google bekannt, gleich zwei Standalone-VR-Headsets auf den Markt bringen zu wollen. Mit Qualcomm arbeite Google an einem Referenzdesign und HTC und Lenovo werden als Partner für die Herstellung und Vermarktung genannt. Da die Brillen ohne Smartphone auskommen, können so die Bewegungen des Nutzers deutlich genauer erfasst werden. Google nennt das Ganze “WorldSense”. Nachfolgend könnt Ihr Euch ein Video dazu ansehen:

Info: Mit dem Klick auf das Video werden Daten an YouTube übertragen.

Auf der Keynote wurden ebenfalls noch Punkte angesprochen, die Entwickler betreffen. Wir haben uns in diesem Artikel jedoch nur auf die für Konsumenten relevante Themen beschränkt.

Dieser Artikel wurde gemeinsam von Kevin Theil und Thorsten Siemeister verfasst.

Pingback: KosmonautenFunk-Podcast #5: Alles zur Google I/O - kommentiert von unseren Autoren • APPkosmos